Introduction

- Mask annotation만 가지고 instance segmentation을 할수 있는 방법을 제한안 논문이다.

- 2개의 loss만을 가지고 single shot 학습을 했다는 점이였고 기존에서는 몇개의 step을 사용하여 pseudo label을 만들었지만 이 논문에서는 box와 label간의 color의 similarity를 가지고 loss를 주었다.

Method

- 기존의 network 의 방식은 이전에 연구가 되어졌던 condinst의 방식을 사용하였으며 이 network의 경우 one stage instance segmentation의 관한 논문으로 RPN이 없다는점이 큰 특징이다.

- 또한 instance만큼의 head가 나와 instance수만큼의 mask가 개별적으로 나온다는게 특징이다.

그렇다면 2가지의 Loss는 어떤것일까?

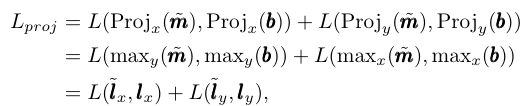

- projection loss term

- 저자는 box와 instance mask의 annotation을 proejction을 시키면 같을 것이라는 가정으로 los를 제안하였다.

- 따라서 밑에 있는 수식과 같이 mask 와 bbox의 x축과 y축을 projection한값의 Dice loss를 적용하여 loss를 만들었다 .

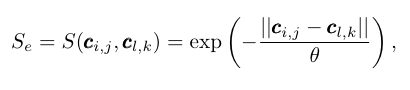

- Pairwise affinity loss term

- 두번째는 undirected graph를 사용하여 만든 loss이다.

- 밑의 수식을 보았을떄 network가 예측되어진 2개의 (i,j) 와 (k,l)의 좌표과 관련이 있다면 1이 나오고 아니면 0이 나오게 되어지는 수식을 의미한다.

- 이를 통해서 2개의 loss를 줌으로써 개선을 시킨다고 하는데 어떻게 box annotation이 없는데 pairwise affinity loss를 줄수가 있을까?

- Learning without Mask Annotations

- 위의 언급했던것처럼 mask annotation이 없음으로 mask를 만들기 위해서 color similarity를 사용을 한다.

- 수식처럼 각 edge에 대해서 LAB space에서 color vector의 similarity를 계산을 한다.

- 그리고 난후 cocoval 2017의 mask에서 가장 적절한 threhold를 찾아내었다고 한다.

- 따라서 최종적인 loss의 경우 왼쪽 수식처럼 pair wise loss로 적용이 되었다.

실험결과

- ablation study의 경우는

- threshold의 조정과 color similarity의 diliationd의 범위와 loss의 변화점에 대해서 변화를 보여주었음.

- 좋은 성능은 획득했으나 몇가지의 아쉬운 case들이 있다. 이는 2가지의 Loss를 주었음에도 constraints가 있음을 보여준다.

반응형

'공부 > paper review' 카테고리의 다른 글

| [Paper Review] A brief Two-stage instance segmentation review (0) | 2022.12.02 |

|---|---|

| [paper review] A Survey on Instance Segmentation: State of the art (0) | 2022.12.01 |

| 220622 묵상 (0) | 2022.06.22 |

| [Paper review] SOLOv2: Dynamic and Fast Instance Segmentation (0) | 2022.04.07 |

| [Paper review] SOLO: Segmenting Objects by Locations (0) | 2022.04.07 |